Bańka filtrująca, bańka wyboru a bańka informacyjna. Próba podziału, definicji i analizy zjawisk

Wiktor Nowak

Bańka filtrująca, bańka wyboru a bańka informacyjna. Próba podziału, definicji i analizy zjawisk

Termin filter bubble stworzony i zdefiniowany przez Eli Parisera[1] tłumaczony jest w Polsce jako „bańka filtrująca” lub często „bańka informacyjna”[2]. Niniejszy artykuł stara się rozdzielić oba polskie terminy, nadać inne – szersze znaczenie terminowi bańki informacyjnej oraz przeanalizować zależności zachodzące między terminami wraz z podkreśleniem ich różnic. Ponadto analizie poddane zostaną komentarze czytelników mediów, które uważane są za kierujące swoje treści do odbiorców posiadających sprecyzowane poglądy polityczne tj. wPolityce.pl i „Gazeta Wyborcza”. Podobieństwa i różnice w komentarzach na Facebooku danego medium oraz na jego stronie internetowej pozwolą na rozdzielenie odbiorców trafiających do danego artykułu na podstawie algorytmów serwisów społecznościowych i tych, którzy wybrali dane medium ze względu na zbieżność idei oraz poglądów z jego linią redakcyjną. Dzięki temu będzie można stwierdzić, jak bardzo bańka filtrująca w klasycznym znaczeniu, czyli działania algorytmów, różni się od bańki tworzonej samodzielnie przez każdego odbiorcę mediów.

Zgodnie z definicją przedstawioną przez Eli Parisera w 2011 r. termin filter bubble oznacza takie działanie algorytmów w mediach społecznościowych, wyszukiwarkach internetowych lub stronach internetowych, które sprawdza, jakie rzeczy lubimy, co najczęściej czytamy lub udostępniamy, by następnie wyświetlane treści skroić pod danego użytkownika. Poprzez te przewidywania każdy użytkownik danego medium internetowego otrzymuje informacje, które tworzą dla niego jedyny i niepowtarzalny newsfeed[3]. Wartym podkreślenia jest fakt działania tego mechanizmu również na stronach internetowych mediów. Używany jest do dostosowywania reklam oraz treści newsowych na danej stronie do naszych preferencji[4]. Świadczy o tym chociażby sekcja „Wybrane dla Ciebie” na głównej stronie serwisu onet.pl[5].

Te dwie metody dopasowywania treści do użytkownika, pomimo podobieństwa (pokazywanie artykułów związanych z wcześniejszymi wyszukiwaniami), mają jednak inne oddziaływanie na użytkownika. W mediach społecznościowych lub wyszukiwarkach treści nie wybraliśmy medium wraz z jego linią redakcyjną, aby otrzymać artykuły. To algorytm wybiera, które media pokaże pierwsze. Podczas targetowania np. na stronie Onetu, wybór medium mamy już za sobą. Możemy przypuszczać, że artykuły będą pisane w określonej linii redakcyjnej, więc to, z jakimi poglądami się spotykamy, wybraliśmy sami, a nie algorytm.

Jednak to, w jaki sposób trafiamy na daną informację i przez to do jakiej bańki należymy, nie jest rozróżniane w pojęciu „bańki informacyjnej”. Definicyjnie informacja różni się od filtra. Jedną z definicji Słownika Języka Polskiego słowa „filtr” jest „program komputerowy dokonujący selekcji lub prostego przekształcenia danych wejściowych lub wyjściowych”[6], a więc jednoznacznie pojęcie to mówi o algorytmach komputerowych. Podobnie termin filter definiowany jest w języku angielskim – jako czasownik jest to selekcja konkretnych informacji z określonego zbioru[7]. Z kolei informacja jest pojęciem pierwotnym, nie definiowalnym, w potocznym znaczeniu – konstatacja stanu rzeczy, wiadomość[8]. Tym samym określenie bańka filtrująca, używane na zjawisko przedstawione przez Eli Parisera, wydaje się sformułowaniem właściwszym i bliższym oryginalnemu znaczeniu niż bańka informacyjna. Ten drugi termin mógłby posłużyć zjawisku szerszemu, zawierającemu w sobie bańkę filtrującą, jak i samodzielne wybory czytelników oraz odbiorców informacji, które wpływają na to, w jakiej bańce się zamykają. Wszak algorytmy również dostarczają nam informacji oraz powodują nasze zamykanie się na inne poglądy i zjawiska. Proponowane rozwiązanie pozwoliłoby na precyzyjniejsze określenie poszczególnych zjawisk i wyeliminowałoby możliwe różne rozumienie terminu bańka informacyjna.

Już w 1997 r. Marshall Van Alstyne i Erik Brynjolfsson zwrócili uwagę na zrzeszanie się internautów w mniejszych grupach, które dzielą podobne zainteresowania. Zjawisko to nazwali bałkanizacją internetu lub cyberbałkanizacją – od podziałów, które zachodziły w byłej Jugosławii. Przekonywali, że zarówno fani Star Treka jak i członkowie grup militarnych mogą z łatwością odnaleźć się w Internecie, wymieniać się informacjami oraz dzielić swoje pasje. Według nich większość z takich dyskusji może nie dotrzeć do szerokiej opinii publicznej, gdyż członkowie tych forów są bardzo niskim odsetkiem społeczności danego regionu czy nawet kraju. W końcu ich relacje i wymiany zdań mogą polaryzować ich poglądy[9]. W prosty sposób można przełożyć to na politykę, obserwując rosnący ruch Q-Anon czy grupy zwolenników partii politycznych na Facebooku. I o ile bańka filtrująca na pewno pomaga im w ugruntowywaniu swoich poglądów, to przynależność do takich zrzeszeń jest samoistnym wyborem tych jednostek. Termin cyberbałkanizacji przydatny jest do określenia szerokiego zjawiska, jednak przekładanie go na jednostki i twierdzenie o ich bałkanizacji nie wydaje się trafione.

O wiele lepszym terminem dla odniesienia zjawiska samodzielnego wyboru mediów i newsów, które się konsumuje, wydaje się ten wskazany przez dr. Richarda Fletchera. Podzielił on personalizację informacji na personalizację samodzielnego wyboru (self-selected personalization) i personalizację przed wyborem (pre-selected personalization)[10]. Ta pierwsza jest dokonywana samodzielnie przez czytelników poprzez wybór konkretnej gazety, portalu czy stacji telewizyjnej i konsumpcję informacji z tego źródła. Ta druga dotyczy głównie algorytmów – jest robiona dla człowieka, a nie przez człowieka. Wprost odnosi się ona do pojęcia bańki filtrującej, która jest efektem personalizacji przed wyborem. Jako nazwę terminu odnoszącego się do efektu personalizacji samodzielnego wyboru można zaproponować “bańka wyboru”. Pojęcie te zachowuje spójność z poprzednim nazewnictwem poprzez odniesienie do tworzenia się bańki, a jednoznacznie wskazuje, że została ona wybrana samodzielnie przez daną osobę. Oba te pojęcia wspólnie tworzą bańkę informacyjną.

Pomimo z pozoru odmiennych definicji obu baniek posiadają one część wspólną. Precyzyjniej – bańka filtrująca posiada elementy wyboru. Algorytm wybiera, co nam pokazać, na podstawie naszej wcześniejszej aktywności, a więc polubień stron, wyszukiwań, kliknięć linków itd. Poprzez rozpoczęcie obserwowania danej strony na Facebooku wykonujemy świadomy wybór. Ta strona nam się podoba (a przynajmniej tak twierdzi Facebook) albo chcemy częściej oglądać treści publikowane przez tę stronę. Wybór ten jest w większości świadomy. Nie jest to jednak takie oczywiste, kiedy polubimy post znajomego, który udostępnia link do danego portalu lub po prostu zatrzymamy się dłużej na danym poście. Nie mamy również wpływu na to, czy konkretne medium, które wybraliśmy poprzez kliknięcie „Obserwuj stronę” wyświetli nam się danego dnia na naszym newsfeedzie. W 2018 roku aż 48% Europejczyków nie słyszało nigdy słowa „algorytmy” lub nie wiedziało, na czym algorytmy polegają. Dużą wiedzę o algorytmach wskazało jedynie 11 % Polaków[11]. To, jak dużą częścią bańki filtrującej będzie nasz świadomy wybór, zależy więc w ogromnej mierze od naszej świadomości, w jaki sposób działa algorytm i na podstawie których naszych zachowań. Dzięki naszej wiedzy możemy zmniejszyć wpływ bańki filtrującej na docierające do nas informacje i zwiększyć udział bańki wyboru.

Można zapytać o zasadność podziału na bańkę filtrującą i bańkę wyboru. Wszak prawie niemożliwym jest, aby człowiek funkcjonował jedynie w bańce filtrującej lub jedynie w bańce wyboru (chyba, że nie korzysta z Internetu). Jednak rozdzielenie tych terminów pozostaje niezbędne, aby prawidłowo wskazać cechy każdej z baniek, ocenić ich wpływ na odbiorców i być świadomym występowania takich zależności oraz zjawisk, by możliwie jak najbardziej świadomie konsumować media. Istnieją znaczące różnice pomiędzy tymi bańkami, które pozwalają nam przeanalizować wady i zalety poszczególnych rozwiązań, by następnie móc proponować zmiany czy to algorytmów, czy zachowań społecznych, czy nawet prawa.

Jedną z większych różnic jest reprezentatywność informacji podawanej nam poprzez algorytmy i tej wybranej przez nas. Papierowe wydanie gazety, serwis informacyjny w telewizji lub radiu czy nawet strona internetowa dużego medium powinny przekazywać najważniejsze informacje danego dnia. I pomimo różnic w treści danej informacji oraz oceny danego zdarzenia, w większości przypadków tak się dzieje, co pokazują badania Stowarzyszenia Analityków Mediów Elektronicznych dotyczące tematów materiałów w trzech największych serwisach informacyjnych w Polsce[12]. Dzięki temu nawet nie czytając tematu okładkowego czy nie w pełni skupiając się na pierwszym materiale w serwisie informacyjnym, mamy choćby szczątkowe pojęcie na temat zdarzeń, które wydarzyły się danego dnia. Przez to jesteśmy świadomi naszej niewiedzy na dany temat (known unknown). W przypadku polegania wyłącznie na algorytmach może okazać się, że informacja bardzo ważna może nas ominąć i nie będziemy nawet świadomi, że o czymś nie wiemy (unknown unknown).[13] Informacje na temat wojny w Afganistanie czy o tym, kto jest obecnym premierem, mogą nie wyświetlić się nam na Facebooku, bo nigdy nie byliśmy tym zainteresowani (według pojęcia zainteresowania stosowanego przez Facebooka) i algorytm stwierdził, że tym razem też tak będzie. Przez to stajemy się niepełnowartościowymi obywatelami, którzy będą bardziej podatni na fałszywe informacje czy propagandę polityczną, poprzez niemożność oceny, jak bardzo dana informacja jest stronnicza, ponieważ nie możemy jej porównać do innych źródeł[14].

Kolejnym problemem bańki filtrującej jest niedemokratyczność procesu tworzenia algorytmów. Giganci ery Internetu stworzyli system, który sprawia, że coraz dłużej korzystamy z ich stron internetowych. Oglądamy reklamy dzięki którym te przedsiębiorstwa zarabiają, jednak tak naprawdę nikt nie wie, jak dane algorytmy działają. Dla wielu są one niewidoczne i przez to nie mamy nad nimi żadnej kontroli[15]. W wielu przypadkach nawet sami informatycy pracujący nad danymi algorytmami nie do końca mogą je zrozumieć[16]. Może okazać się, że algorytm wybierze treści, które w ogóle nie zostaną pokazane większej liczbie osób[17]. Przewaga bańki wyboru w tym elemencie jest wyraźnie widoczna. Mamy pełną kontrolę nad tym, jaką stację telewizyjną włączymy albo jaką gazetę kupimy w kiosku. Oczywiście, w obu przypadkach mogą pojawić się próby manipulacji informacją z poziomu właściciela – czy to dużej korporacji, czy gazety. Wracając jednak do reprezentatywności informacji, w przypadku bańki filtrującej ciężej nam będzie ją zauważyć. Skoro nie widzimy samych algorytmów, nie możemy zobaczyć, jak nami manipulują.

Media społecznościowe, a wraz z nimi algorytmy, które nimi zarządzają, doprowadziły również do sytuacji, w której mniej zwracamy uwagę na pełną informację, a zadowalamy się jedynie jej skrótem. Forma przedstawiania informacji w mediach społecznościowych, a więc obraz, tytuł i krótka zajawka materiału, sprawiają, że nie potrzebujemy już czytać całości informacji. Pokazuje to czas spędzony na danej stronie przez użytkowników, którzy weszli na nią bezpośrednio i tych, którzy zostali przekierowani z Facebooka lub wyszukiwarki Google. Użytkownicy przychodzący na stronę bezpośrednio spędzają na niej średnio 4 minuty i 26 sekund, natomiast ci będący na nią przekierowani – niewiele ponad półtorej minuty[18]. Jako świadomi czytelnicy jesteśmy wierniejsi danemu medium. Jednak jeśli chodzi o interesy mediów, możliwe że korzystniejsze jest przekierowywanie ruchu z nowych mediów. Im więcej użytkowników, tym więcej wyświetlanych reklam, które generują zysk. Dlatego też widzimy, że media prześcigają się w wyścigu o najbardziej angażujący tytuł i ilustrujący go obrazek, aby dzięki clickbaitowi zdobyć jak najwięcej lajków, udostępnień i wejść na stronę, przez co zarabiają więcej pieniędzy. Ponadto algorytm został zaprojektowany tak, aby wywoływać w nas silne emocje, zarówno te pozytywne, jak i negatywne. Dzięki temu spędzamy więcej czasu na portalu, a nasza uwaga jest w tym przypadku bardzo cenną walutą[19]. Nie dziwi więc zachowanie mediów, które starają się wpasować w te realia.

Poświęcając swój czas i uwagę mediom społecznościowym, możemy wykształcić w sobie coś na wzór uzależnienia od treści i często ostatnio poruszanego problemu FOMO (fear of missing out – lęk przed opuszczeniem czegoś). Nawet chwilowe wyjście poza serwis może wywołać w nas wrażenie, że właśnie omija nas najważniejsza informacja dnia[20]. Poprzez różne sposoby na zmuszenie użytkownika do nieopuszczania serwisu algorytmy zamykają nas w bańce, którą same dla nas przygotowały. Coraz ciężej jest się wyrwać poza jej ramy i czytać treści z innych miejsc. To powoduje w nas odejście od samodzielnego wyboru mediów, które chcemy konsumować i całkowite powierzenie naszej diety medialnej Facebookowi, Twitterowi czy YouTubowi, które przygotują dla nas odpowiedni zestaw treści.

Jak wynika z badań przeprowadzonych w 2011 roku, prawdopodobieństwo spotkania osoby o innych poglądach politycznych jest częstsze w Internecie niż w realnym życiu[21]. Wedlug Setha Stephensa-Davidowitza to dowód na to, że Internet nie jest mocno podzielony i dzieje się tak z dwóch powodów. Po pierwsze przemysł informacyjny jest zdominowany przez kilka dużych portali, po drugie wiele osób odwiedza portale informacyjne z przeciwnej strony po to, żeby podjąć polemikę z przeciwnikami[22]. Dzięki temu czytają wiadomości i komentarze, które tam się pojawiają. To może sugerować kolejny podział bańki wyboru na bańkę wyboru w życiu realnym i internetowym, jednak to temat na osobny artykuł.

Otwartym pozostaje pytanie, która z baniek bardziej nas zamyka w gronie osób o podobnych poglądach? Czy algorytmy ugruntowują naszą bańkę wyboru czy może jednak otwierają nas na nowe idee? Czy staramy się wychodzić poza własną strefę komfortu, czy jednak czytamy i oglądamy treści, z którymi się wyłącznie zgadzamy? Na te pytania próbuję odpowiedzieć poprzez badanie treści komentarzy zarówno na Facebooku, na którym działają algorytmy pozycjonujące, jak i na stronach konkretnych mediów. Do badania wybrane zostały „Gazeta Wyborcza” i wPolityce. Oba to serwisy internetowe. Wybór nastąpił na podstawie skrajnych linii redakcyjnych portali. „Gazeta Wyborcza” jest kojarzona z odbiorcami opozycji liberalnej, a wPolityce ze zwolennikami rządzących konserwatystów. Dzięki temu będzie można zauważyć ewentualne różnice pomiędzy bańką prawicową a liberalną oraz działanie algorytmów w stosunku do różnych poglądów politycznych.

Badanie przeprowadzono na jednym artykule zarówno na portalu wpolityce.pl[23] jak i wyborcza.pl[24]. W obu tytułach dotyczył on dymisji Jarosława Gowina. Artykuły zostały opublikowane na stronach internetowych tego samego dnia (10 sierpnia), a przekierowujące do nich posty na Facebooku opublikowano o podobnej godzinie (wPolityce o 18:11[25], „Gazeta Wyborcza” o 18:09[26]). Dzięki podobnej tematyce artykułów (artykuł „Gazety Wyborczej” jest obszerniejszy) oraz zbliżonej dacie ich publikacji można wyeliminować czynniki zmienne. Ponadto oba artykuły są napisane bez wypowiedzi ocennych ze strony dziennikarzy. To pozwala wyeliminować sugerowanie się treścią artykułu przez komentujących. Duży oddźwięk informacji o dymisji Jarosława Gowina sprawił, że w materiale do analizy pojawiło się zdecydowanie więcej komentarzy niż w przypadku wielu innych artykułów pojawiających się w tym czasie. Dzięki temu analizie poddana została większa liczba danych i pojawiły się komentarze pisane przez osoby, które na co dzień nie są tak aktywne w komentowaniu postów czy artykułów. To daje możliwość sprawdzenia szerszej bańki niż tylko osób najbardziej zaangażowanych. Wszystkie te czynniki pozwalają na jak największe zobiektywizowanie badania. Oczywiście najlepszym badaniem baniek informacyjnych byłoby ciągłe analizowanie komentarzy pod postami i artykułami największych mediów, partii politycznych i ich polityków. Pozwoliłoby to nie tylko na sprawdzenie, jak wygląda konkretna bańka w danej chwili, ale również w jaki sposób się ona zmienia i w jakich tematach bańki mogą się łączyć. Jednak z uwagi na brak możliwości przeprowadzenia takiego badania pozostaje ono jedynie propozycją i postulatem skierowanym do organizacji pozarządowych oraz katedr medioznawczych uniwersytetów.

Do badania zostały wykorzystane wszystkie komentarze, które pojawiły się pod artykułami w „Gazecie Wyborczej” i portalu wPolityce.pl oraz pod postami na Facebooku promującymi te artykuły. Należy zaznaczyć, że w każdym z tych miejsc jedna osoba może pozostawić więcej niż jeden komentarz. Żeby skomentować post na Facebooku, należy mieć konto na tym portalu, jednak ze względu na jego powszechność i darmowość nie jest to czynnik wpływający na ostateczne wyniki. Portal wPolityce.pl daje możliwość komentowania wszystkim użytkownikom, którzy weszli na stronę. Natomiast na portalu wyborcza.pl obowiązuje paywall zarówno na czytanie tekstów, jak na komentowanie ich. W związku z tym można założyć, że komentarze, które tam się pojawiają, będą w dużej mierze zgodne ze sobą oraz z linią redakcyjną portalu, co również zostanie zweryfikowane w badaniu.

Każdy z komentarzy został zaklasyfikowany do jednej z 4 kategorii.

- Komentarze proPiS, tj. komentarze, które wyrażają wsparcie dla Mateusza Morawieckiego i całego rządu, wyrażają zadowolenie z dymisji Jarosława Gowina ze względu na jego zdanie w wielu sprawach odmienne od kierownictwa PiS-u, których autorzy z troską i zaniepokojeniem zastanawiają się nad dalszym losem rządów Zjednoczonej Prawicy, a przy okazji wyrażają się nieprzychylnie o Jarosławie Gowinie i Porozumieniu.

- Komentarze proGowin, tj. komentarze, które wyrażają niezadowolenie z dymisji Jarosława Gowina, opisują Jarosława Gowina jako najlepszego polityka w obozie Zjednoczonej Prawicy.

- Komentarze antyrządowe, tj. komentarze cieszące się z dymisji Jarosława Gowina ze względu na możliwy rozpad rządu Zjednoczonej Prawicy, krytykujące rząd i Zjednoczoną Prawicę, wyraźnie popierające opozycję lub pragnące przyspieszonych wyborów; komentarze, których autorzy zastanawiają się, w jaki sposób PiS skonstruuje nową większość parlamentarną i krytycznie wypowiadają się o podmiotach, które mogą im w tym pomóc. W ostatnim kryterium pojawiały się komentarze krytyczne wobec partii opozycyjnych takich jak PSL, Lewica czy Konfederacja, które według ich autorów mogłyby rozpocząć współpracę z PiS-em, jednak ze względu na ich wydźwięk zostały zakwalifikowane w tej kategorii.

- Inne, tj. komentarze, w których nie można jasno stwierdzić przynależności do jednej z pozostałych grup, które analizują sytuację polityczną bez wypowiedzi ocennych, bez związku z tematem artykułu i sprawami politycznymi, będące odpowiedzią ad personam do rozmówcy z komentarzy i które nie nawiązują do meritum.

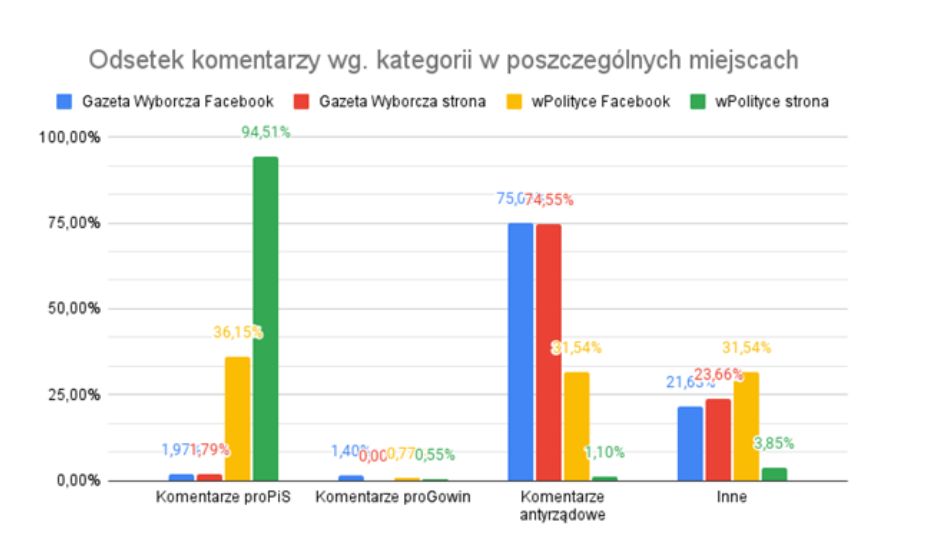

Przeanalizowano 356 komentarzy pod postem na facebookowym profilu „Gazety Wyborczej” i 224 na jej stronie internetowej. Z kolei w przypadku portalu wPolityce.pl na Facebooku przeanalizowano 130 komentarzy, a na stronie – 182.

Badanie wykazało istotne różnice pomiędzy treścią komentarzy w „Gazecie Wyborczej” a w wPolityce. Zdecydowana większość komentarzy w GW zarówno na Facebooku, jak i na stronie (ok. 75%) była nastawiona antyrządowo. Inaczej wyglądała sytuacja na drugim portalu. O ile komentarze proPiS dominowały na stronie internetowej (prawie 95%), to już pod postem na Facebooku rozkład pomiędzy komentarzami proPiS, antyrządowymi i innymi był dość równy (31,54% antyrządowych i innych, 36,15% proPiS). We wszystkich badanych miejscach znikomy jest odsetek komentarzy proGowin, co na pewno jest ciekawą informacją dla analizy politologicznej.

Niniejsze dane wyraźnie pokazują istnienie baniek informacyjnych. Nie tylko tych filtrujących w mediach społecznościowych, ale również baniek wyboru. Zauważalne jest inne podejście odbiorców treści obu portali, inne poglądy polityczne, a co za tym idzie – zamykanie się w bańkach skupiających ludzi o podobnych poglądach. Przypadek „Gazety Wyborczej” pokazuje, że czytelnicy komentujący jej artykuły są wyraźnie antyrządowi. Co ciekawe, zarówno na Facebooku, jak i stronie wyborcza.pl, odsetek komentarzy z danej kategorii jest bardzo podobny. Szczególnie istotne jest to ze względu na utrudniony dostęp do sekcji komentarzy na stronie internetowej. Tak jak zostało wspomniane wcześniej, dostęp do „Gazety Wyborczej” dostępny jest za paywallem, tj. dopiero osoba, która zdecyduje się na wykupienie dostępu do portalu, może komentować artykuły. Pomimo tego odsetek komentarzy antyrządowych jest niższy niż odsetek komentarzy proPiS na stronie wPolityce.pl, a tam dostęp do komentarzy jest darmowy i łatwo dostępny. Należy jednak zwrócić uwagę, że prawie wszystkie pozostałe komentarze „Gazety Wyborczej” zostały oznaczone jako „inne”, często takie, które w szerszym kontekście (np. znajomości poglądów politycznych piszącego) zostałyby ocenione w którejś z kategorii. Z tego powodu wniosek o mniejszym spolaryzowaniu bańki informacyjnej „Gazety Wyborczej” jest nieuprawniony. Należy jednak stwierdzić, że nie ma większych różnic pomiędzy bańką filtrującą a bańką wyboru na tym portalu. Oczywiście z zaznaczeniem, że bańka filtrująca ma elementy własnego wyboru i że czytelnicy mogli przechodzić z posta na Facebooku do artykułu na stronie internetowej.

Inaczej sytuacja ma się w przypadku wPolityce.pl. Zauważalna jest znacząca różnica pomiędzy komentarzami na stronie internetowej, które w przeważającej większości są proPiS i komentarzami na Facebooku, gdzie komentarze proPiS, antyrządowe i inne rozkładają się prawie równo. Może to sugerować głęboką polaryzację bańki wyboru wPolityce oraz częstsze wizyty osób spoza tej bańki na profilu Facebookowym tego portalu. Osoby angażujące się w dyskusję na portalu musiały wykonać większą pracę, tj. wejść na stronę i przeczytać artykuł, aby skomentować go, natomiast Facebook pozwala przeczytać jedynie zajawkę tekstu, by go skomentować. Wynika z tego, że odbiorcy antyrządowi częściej angażują się w dyskusje na Facebooku portali uchodzących za prorządowe, jednak już nie przechodzą do rozmowy na samym portalu. W tym wypadku bańka wyboru znacząco różni się od bańki filtrującej, która wszak nie bada, czy pozostawiony przez nas komentarz jest pochwalający czy negujący dane treści[27]. Dlatego portal wPolityce.pl może pojawiać się w newsfeedzie osób o poglądach liberalnych, jeśli często wchodzą z nim w interakcje, nawet jeśli jest ona jedynie krytyką artykułów lub posunięć rządu.

Badanie to pokazuje jedynie pewien wycinek baniek tych dwóch portali. Wnioski z niego powinny być poddane kolejnym, szerszym badaniom na większej liczbie artykułów, w dłuższym przedziale czasowym. Wskazanym byłoby również przeprowadzenie ankiet na czytelnikach portali z pytaniami o ich poglądy polityczne, najczęściej konsumowane media czy o to, w jaki sposób trafili na stronę czy post danego medium.

Jednak podstawowe wnioski jakie można wyciągnąć z tego badania to, że bańki informacyjne istnieją oraz, że bańka filtrująca może znacząco różnić się od bańki wyboru. To pokazuje, że rozróżnienie zaproponowane w pierwszej części artykułu jest jak najbardziej potrzebne. Klasyfikacja wszystkich zjawisk jako bańka informacyjna może być mocno myląca i niewłaściwie określać dane zjawisko. Warto kontynuować badania nad tym zjawiskiem, szczególnie w kontekście podziałów społecznych tworzonych przez bańki, języka nienawiści i hejtu wyrażanego w życiu publicznym, a szczególnie w Internecie i działań mediów oraz twórców algorytmów w kontekście sterowania podziałami społecznymi.

Bibliografia:

Anderson M., Caumont A., How social media is reshaping news, Pew Research Center, Waszyngton 2014. https://www.pewresearch.org/fact-tank/2014/09/24/how-social-media-is-reshaping-news/

Cambridge Dictionary, Cambridge University Press hasło: filter https://dictionary.cambridge.org/pl/dictionary/english/filter

Durzewska M., Migracje mentalne. Wzory myślenia a przynależność grupowa w przestrzeni „baniek informacyjnych”, w: Studia kulturoznawcze 2(15)2018, Wydawnictwo Naukowe Wydziału Nauk Społecznych, Poznań 2018. https://repozytorium.amu.edu.pl/bitstream/10593/24889/1/Durzewska%20Migracje%20mentalne%20a%20banki%20informacyjne.pdf

Encyklopedia Wydawnictwa Naukowego PWN hasło: informacja https://encyklopedia.pwn.pl/haslo/informacja;3914686.html

Fletcher R., The truth behind filter bubbles: Bursting some myths, Reuters Institute for the Study of Journalism, Oxford 2020. https://reutersinstitute.politics.ox.ac.uk/risj-review/truth-behind-filter-bubbles-bursting-some-myths

Gentzkow M., Shapiro J. M., Ideological Segregation Online and Offline, w: Quarterly Journal of Economics 126(4), Oxford University Press, Oxford 2011. https://www.nber.org/papers/w15916

Kondzińska A. Morawiecki wyrzucił Gowina z rządu. Porozumienie wychodzi z rządowej koalicji, wyborcza.pl, 2021. https://wyborcza.pl/7,75398,27435283,morawiecki-wyrzucil-gowina-z-rzadu-to-oznacza-koniec-rzadowej.html

Kosińska O. Algorytm nie mruga. wpływ algorytmu zarządzającego portalem YouTube na rzeczywistość społeczną., w: Kultura Współczesna 1(104)/2019, Narodowe Centrum Kultury, Warszawa 2019. https://nck.pl/upload/2019/11/8_algorytm-nie-mruga.pdf

Malinowski B., Jak Facebook zamyka nas w bańce informacyjnej. Algorytm filtrujący newsfeed a zjawisko filter bubble, w: Zarządzanie Mediami. 4(1), Wydawnictwo Uniwersytetu Jagiellońskiego, Kraków 2016. https://www.ejournals.eu/ZM/Tom-4/1-2016/art/7738/

Pariser E., The filter bubble. What the Internet is Hiding from You., Penguin Books, Nowy Jork 2011.

Premier złożył wniosek o odwołanie Gowina z rządu! „Z niepokojem obserwujemy działania, które podejmuje wicepremier”, wpolityce.pl, 2021. https://wpolityce.pl/polityka/561964-premier-zlozyl-wniosek-o-odwolanie-gowina-z-rzadu

Rządzą nami algorytmy, a wiemy o nich niewiele, Deutsche Welle, 2019. https://www.dw.com/pl/rządzą-nami-algorytmy-a-wiemy-o-nich-niewiele/a-47391381

Słownik Języka Polskiego Wydawnictwa Naukowego PWN hasło: filtr https://sjp.pwn.pl/szukaj/filtr.html

Szpyt-Wiktorowska J., Strategie mediów wobec baniek informacyjnych, w: Zarządzanie Mediami. 6(1), Wydawnictwo Uniwersytetu Jagiellońskiego, Kraków 2018. https://www.ejournals.eu/ZM/2018/1-2018/art/12881/

Stephens-Davidowitz S., Wszyscy kłamią. Big data, nowe dane i wszystko, co internet nam powiedzieć o tym, kim naprawdę jesteśmy, przeł. M. Świerkocki, Wydawnictwo Literackie, Kraków 2019.

Vaidhyanathan S., Anti Social Media. Jak Facebook oddala nas od siebie i zagraża demokracji., przeł. W. Mincer, K. Sosnowska, W.A.B., Warszawa 2018.

Van Alstyne M., Brynjolfsson E., Electronic Communities: Global Village or Cyberbalkans?, MIT Sloan School, Cambridge 1997.

https://web.archive.org/web/20160405024307/http://web.mit.edu/marshall/www/papers/CyberBalkans.pdf

[1] E. Pariser, The filter bubble. What the Internet is Hiding from You, Penguin Books, 2011.

[2]https://repozytorium.amu.edu.pl/bitstream/10593/24889/1/Durzewska%20Migracje%20mentalne%20a%20banki%20informacyjne.pdf, dostęp: 04.08.2021.

- Szpyt-Wiktorowska, Strategie mediów wobec baniek informacyjnych, „Zarządzanie Mediami” 2018, 6(1), s. 41.

https://www.ejournals.eu/ZM/Tom-4/1-2016/art/7738/ dostęp 04.08.2021 r.

[3] E. Pariser, dz. cyt., s. 9.

[4] Tamże, s. 45.

[5] onet.pl, dostęp: 04.08.2021.

[6] https://sjp.pwn.pl/szukaj/filtr.html, dostęp: 13.08.2021.

[7] https://dictionary.cambridge.org/pl/dictionary/english/filter, dostęp: 13.08.2021.

[8] https://encyklopedia.pwn.pl/haslo/informacja;3914686.html, dostęp: 13.08.2021.

[9] https://web.archive.org/web/20160405024307/http://web.mit.edu/marshall/www/papers/CyberBalkans.pdf, dostęp 13.08.2021.

[10] https://reutersinstitute.politics.ox.ac.uk/risj-review/truth-behind-filter-bubbles-bursting-some-myths, dostęp: 13.08.2021.

[11] https://www.dw.com/pl/rządzą-nami-algorytmy-a-wiemy-o-nich-niewiele/a-47391381, dostęp: 13.08.2021.

[12] Badania były publikowane na stronie na Facebooku Stowarzyszenia w okresie 21.04.2020 r.- 02.06.2021 r. https://www.facebook.com/Stowarzyszenie-Analityków-Mediów-Elektronicznych-108366947509346/

[13] E. Pariser, dz. cyt., s. 106.

[14] Tamże, s. 107.

[15] Tamże, s. 218.

[16] Tamże, s. 202.

[17] https://nck.pl/upload/2019/11/8_algorytm-nie-mruga.pdf, dostęp: 20.08.2021.

[18] https://www.pewresearch.org/fact-tank/2014/09/24/how-social-media-is-reshaping-news/, dostęp: 22.08.2021.

[19] S. Vaidhyanathan, Anti Social Media. Jak Facebook oddala nas od siebie i zagraża demokracji, W.A.B., 2018, s. 16.

[20] Tamże, s. 74.

[21] M. Gentzkow, J. M. Shapiro, Ideological Segregation Online and Offline, „Quarterly Journal of Economics”

[22] S. Stephens-Davidowitz, Wszyscy kłamią. Big data, nowe dane i wszystko, co internet nam powiedzieć o tym, kim naprawdę jesteśmy, Wydawnictwo Literackie, 2019, s. 178.

[23] https://wpolityce.pl/polityka/561964-premier-zlozyl-wniosek-o-odwolanie-gowina-z-rzadu, dostęp: 28.08.2021.

[24] https://wyborcza.pl/7,75398,27435283,morawiecki-wyrzucil-gowina-z-rzadu-to-oznacza-koniec-rzadowej.html, dostęp: 28.08.2021.

[25] https://www.facebook.com/wPolityce/posts/5967677986607188, dostęp: 28.08.2021.

[26] https://www.facebook.com/wyborcza/posts/10159092593053557, dostęp: 28.08.2021.

[27] S. Vaidhyanathan, dz.cyt., 2018, s. 292.